ここ数年、検索エンジン、- そのなかでもグーグル – はSEO業者とパブリッシャー(註:サイト運営者の意味ですが、原文のまま使っています)への支援を強化してきていた。しかし、2011年はリンクおよびキーワードのデータが伏せられ、ここまで大きく検索エンジンとの関係が後退したのは、私の知る限り初めてである。以下に何が起きたのか、なぜ重要なのか、そして、グーグルとビングが何も方針を変えなかった場合、パブリッシャーはどうすれば抵抗することが出来るのかについて綴っていく。

目次

検索エンジンは、SEOを、そして、パブリッシャーを嫌っており、まったく助け舟を出していないと考えている人達もいるかもしれない。それは誤りであり、わざと進歩に目を向けないようにしているのか、または、ただ単に状況の変化に気が付いていないだけである。後者の方が可能性は高いだろう。

検索エンジンは、SEOを、そして、パブリッシャーを嫌っており、まったく助け舟を出していないと考えている人達もいるかもしれない。それは誤りであり、わざと進歩に目を向けないようにしているのか、または、ただ単に状況の変化に気が付いていないだけである。後者の方が可能性は高いだろう。

私が今から16年近く前の1996年にSEOの問題を取り上げ始めた際、URLのフォーラム以外、パブリッシャーに対するサポートはほとんどなかった。現在、グーグルウェブマスターセントラル、そして、ビングウェブマスターツールズ等の総合的なツールセット、そして、次の取り組みを可能にする独立型の機能や選択肢が提供されている:

上述したサポート以外にも検索エンジンが提供を始めたサポートはある。現在パブリッシャー達が享受しているサポートは、10年前この業界で働いていた古株のSEOにとって、当時は考えられなかったサービスである。

進化は喜んで受け入れられた。パブリッシャーがウェブの重要な場所、つまり検索エンジンにおける配置を改善する上で大いに役立った。また、検索エンジンにとっても、ユーザビリティおよび関連性にマイナスの影響を与えかねないエラーや問題を解決する上で役に立った。

だからこそ2011年はとても注目に値する年であったのだ。検索エンジンは、数年間前進を続けたものの、大きく後退してしまった。

検索エンジンがウェブページの関連性を決定する上で最も重要な手段の一つに数えられるのが、リンク分析である。つまり、ページにリンクを張っているウェブページ、そして、そのリンクのテキスト – アンカーテキスト – が当該のページについて何と言っているのかを調べる取り組みだ。

しかし、ここ数年、グーグルは故意に外部の人達が特定のページに関してリンクが何を語っているのかを確認する力を抑圧してきた。Santorumで“あの”結果が表示される理由を知りたいだろうか?(註:2012年米国大統領候補の名前。検索すると3位に、ア○ルセックスに使われる潤滑剤のサイトが表示されることが話題になり、一時検索数が劇的に上がった)グーグルが「define English person」に対して“あの”結果を返す(註:カントといえば日本でも有名なドイツ人哲学者ですが、英語では女性器の意味もあり、1位にWikipediaの同結果ページが表示されている→話題になったせいか現在は順位調整済み)理由を知りたいだろうか?残念ながらグーグルは教えてはくれないだろう。

グーグルはリンクがこのような状況を生み出した理由を説明しない。特定のページに向かう全てのリンク、または、ページを説明するためにリンク内で使われた言葉をページのオーナー以外には見せない方針を取っているのだ。

それはなぜだろうか?この情報を提供すると、スパムとの戦いが困難になると言うのがグーグルの建前である。グーグルのリンクレポートを悪用することで、確かに悪人達が恐ろしいリンク戦略を考え出す可能性はなくはない。

なんと内容の薄い主張なのだろう。リンクのデータを提供していなくても、例えば[SEO]のような競争の激しい用語で、単純にフォーラム、クライアントのページ、またはブログのテンプレートにこの用語を落としていけば、グーグルで上位に格付けしてもらうことが出来る点を悲しいぐらい簡単に証明することが出来る。

この点を考慮すると、データを隠すことで、本気でスパムに勝てることが出来るとグーグルが考えているとは理解しがたい。2011年が始まるまでは、容易にグーグルの代わりを探すことが出来た。パブリッシャー達はグーグルのライバルであるヤフー!に向かい、人々がどのようにページにリンクを張っているのかを把握することが出来たのだ。

ヤフー!は2005年9月に“ヤフー!サイトエクスプローラ”を立ち上げた。この取り組みには、グーグルからパブリッシャーを強奪するためのPR的な狙い、そして、パブリッシャーに情報を与える狙いがあった。このツールを使うと、リスティング内のあらゆるページに関してヤフー!が持っているリンクのデータを見ることが出来た。

現在もヤフー!は建前としてはグーグルからユーザーをヤフー!に呼び込みたいと望んでいるだろう。しかし、ヤフー!の検索結果は現在ビングによって提供されているため、ヤフー!にはパブリッシャーを支援するツールを提供する理由はない。事実上、ビングの問題になっているのだ。

ヤフー!はヤフー!サイトエクスプローラを閉鎖し、次のようなメッセージを残した。このメッセージは 今でもサイトに記載されている:

ヤフー!検索はサイトエクスプローラをビングのウェブマスターツールズに統合します。今後は、ウェブサイトがビングおよびヤフー!から質の高い自然なトラフィックを引き続き獲得している点を確認するには、ビング・ウェブマスターツールズを利用する必要があります。

この指摘は誤っている。ヤフー!サイトエクスプローラはビング・ウェブマスターツールズに統合されたわけではなかった。ただ単に閉鎖されただけだ。ビングのウェブマスターツールズは、ヤフー!サイトエクスプローラが用意していたようなページへの被リンクを確認する機能を提供していない。

この閉鎖の決定は、2011年の早い時期に求められた、パブリッシャーの希望に関する“フィードバック”の結果を考慮して出されていたと思われる。ヤフー!がどのようなフィードバックを得たのかは私には分からないが、聞くところによるとパブリッシャー達は、ヤフー!サイトエクスプローラが提供していた機能をヤフー!またはビングに維持してもらいたいと藁にもすがる気持ちで、1年以上も嘆願していたようだ。

司法省がヤフー!とマイクロソフトの提携を認可した際、検索業界の競争は今後も維持されると見られていた。2010年の司法省の見解の一部を以下に記載する:

証拠を十分に検討した結果、当機関は提案された取引が米国での競争を大幅に軽減する可能性は低いと判断した。そのため、インターネット検索、有料検索広告、インターネットパブリッシャー、もしくは検索および有料検索広告テクノロジーの業者に害を与える可能性も低いと見られる。

しかし、ヤフー!サイトエクスプローラの閉鎖はインターネット検索のユーザーおよびインターネットパブリッシャーの双方に害を与えたと私は声を大にして言いたい。ヤフー!サイトエクスプローラはヤフー!が提供するツールの中で唯一の際立ったツールであり、司法省が挙げたカテゴリーの全ての人達が依存する検索エンジンの仕組みを理解する上で役に立っていたのだ。また、独自のツールを提供しなければいけないと言うグーグルに対するプレッシャーも軽減された。

やはりヤフー!サイトエクスプローラが閉鎖されて以来状況は悪化している。昨年の年末、ビングはヘルプフォーラムでリンクコマンドのサポートを中止したと公式に認めた。

リンクコマンドでは、[link]を介して、ページのウェブアドレスを入力し、当該のページへ向かうリンクを見つけることが出来る。このコマンドは、1995年にアルタビスタが始めて以来、多くの主要な検索エンジンで利用することが出来た長い間愛用されてきたコマンドである。

グーグルは、グーグルが把握しているページに向かうリンク(全てではない)を紹介するため、このコマンドを今でもサポートしている。出来ればこのコマンドに関する文書にリンクを張りたいが、グーグルは2008年5月に密かにこの文書を削除していた。そのため、以下に以前記載されていた内容を掲載しておく:

次にこのコマンドの働きを説明する。リック・サントラム氏のキャンペーン用ウェブサイトの公式ホームページに向かうリンクに関するグーグルの情報を例に挙げる:

1本目の矢印は、コマンドを利用する仕組みを示し、2本目の矢印は、グーグルが当該のページに向かう111本のリンクを報告していることを示している。考えてもらいたい。米国大統領選挙の共和党の候補者として有力視されるリック・サントラム氏のウェブサイトのホームページに対して、グーグルはたった111本しかリンクが寄せられていないと報告しているのだ。

実際には遥かに多くのページがリンクを向けているだろう。 グーグルはその他のリンクもカウントしているはずだが、実際にどのように思われているのかを気にする人達に対してリンクの総数を伝えていない。この点に関しては後ほどさらに詳しく検証していくが、まずはビングのさらにひどい現状を知ってもらいたい:

リンクの本数はたった1本。これが、リック・サントラム氏のウェブサイトに向けられているリンクの本数をを知ろうとする人達に対するビングの答えだ。

多くの人達が気にしている。間違いない。私はこの記事を月曜日から書き始めているが、クロームブラウザのグーグル自身の検索結果でのランキングの改善を目論み、グーグルが有料リンク戦略に関わった可能性がある(日本語)経緯を取り上げなければならなくなり中断していた。

グーグルが認可したこのマーケティングキャンペーンの本当の目的は腑に落ちないところがあるが(グーグルは慎重に行動し、グーグル自身にペナルティを与えた(日本語))、グーグル自体に優れたリンクレポートツールが欠けているため、完全に第三者の仕業と決めつけることは出来なかった。

このストーリーが収拾するや否や、今度は、リック・サントラム氏のキャンペーン用ウェブサイトが、「santorum」をアナルセックスの副作用と定義する反サントラムの立場を取った以前から存在するウェブサイトをランキングで上回ることが出来ない理由に注目が集まった。

メジャーなメディアはこぞってこのストーリーを報じている。私の分析は、ざっと確認しただけでも、エコノミスト、CNN、テレグラフ、 ニューヨークタイムズ、MSNBC、そして、マーケットプレイス等のサイトで引用されている。

繰り返すが、私を含む本気で知りたい人達が、グーグルが把握している双方のサイトに向かうリンクを全て確認することが出来るわけではなく、また、これらのサイトを描写するために使われた重要度の高いアンカーテキストについても一部の情報しか公開されていないのが現状だ。グーグルが知っていることを把握しているのはグーグルのみである。

ヤフー!サイトエクスプローラの閉鎖、そして、リンクデータの提供の停止全般に対する苦情を聞いたことがない人もいるかもしれないが、それは、マジェスティックのサイトエクスプローラや私がよく利用するSEOmozのオープンサイトエクスプローラ等の第三者の代わりのツールが存在するためである。

これらの第三者のツールを利用すると、検索エンジンが公開するデータがいかに少ないかが分かる。リック・サントラム氏のキャンペーン用のホームページに対するオープンサイトエクスプローラが提供する被リンクのレポートを見てもらいたい:

1本目の矢印は、ページに3581本のリンクが向けられていることを示している。ここでグーグルがたった111本、ビングにおいてはたった1本しかリンクが寄せられていないと指摘していた点を思い出してほしい。

下の2本の矢印は、サントラム氏のホームページと反サントラムのホームページが受けている外部リンクの本数を示している。これらのリンクはそれぞれのページに向かう外部のサイトからのリンクである。ご覧のように、反サントラムのページは、サントラム氏のキャンペーンページに向かうリンクよりも4倍ほどリンクの本数が多く、これは「santorum」での検索に対して優れた結果を得ている理由の手掛かりと言えるだろう。

しかし、リンクの本数だけではない。その他の レポートを利用したところ、2つのサイトに向かう多くのリンクは共に「santorum」をリンク内のテキストで利用していることが判明した。この用語に対して、2つのサイトが共に上位にランキンしている理由がここにある。

また、反サントラムのウェブサイトは、「santorum」、そして、「spreading santorum」(サントラムを広げる)と言う用語が使われたリンクをサントラム氏の選挙用ページよりも遥かに多く持つ。この傾向は、単一の用語の検索において、このサイトがキャンペーンサイトを上回る上で貢献した可能性がある。しかし、公式サイトは、BBCのように、リンク内に「rick santorum」を用いた数多くサイトを抱えており、なお且つ「ricksantorum.com」のドメイン名を持つため、「rick santorum」で反サントラムのサイトを上回ることに成功している。

第三者のツールを使ってこのような分析を実行することが出来るのは嬉しいが、本来ならばこれらのツールに頼らなくてもよいはずなのだ。グーグルもビングもこのデータを理解するために自らの検索エンジンからユーザーを遠ざけている。これは単純に常軌を逸しており、褒められることではない。

まず、第三者のツールは検索エンジンが何をリンクとしてカウントしているのか心得ているわけではない。第三者のツールは独自のウェブのクロールを基に推測を行っており、グーグルとビングの知識と必ずしも一致しているとは限らない(かなり精度は高いかもしれないが)。

また、検索エンジンは何をカウントしているのかハッキリと伝えるべきである。リンクは検索エンジンの結果を生成するために用いられる“材料”の中心的な素材である。これらの検索結果が健康に良いかどうかを誰かが知りたがっているなら、材料を堂々と公開するべきである。

グーグルとビングは、確かにパブリッシャーが登録しているサイトに関するリンクのデータに関しては今度も提供していくだろう。しかし、そろそろあらゆるサイトに関するリンクのデータを誰でも調べることが出来るようにしてもいいはずだ。

検索エンジン「ブレッコ」はこの機能を提供しており、ログインしたユーザーは誰でもリストアップされたページに対する被リンクの本数を確認することが出来る。さらにブレッコはかつてのヤフー!のように、リンクの本数を自慢することが出来るバッジをページに掲載するオプションまで用意している。しかし、グーグルにとっては、リンクコマンドがページへ向かうリンクを全て表示しなくても特に“問題はない”ようである。冗談ではなく、グーグルのヘルプページにはそのような旨が記載されている。

グーグルはとりわけ検索結果内で見つけたスパムの報告をユーザーに求めてきた。この類の支援を本気で求めているなら、SEO業者がスパムを突き止めることが可能なもっと質の高いツールを提供するべきである。つまり、あらゆるURLのリンクのデータをアンカーテキストのレポート付きで提供するべきなのだ。

また、グーグルは特にソーシャルなつながりが見えるべきだと言う考えに則って、企業に情報を開示する必要性をくどくどと説いてきた。グーグルにはそうしてもらう必要があった。なぜなら、グーグル+が立ち上げられるまでは、フェイスブックが把握しているタイプのソーシャルなつながりを見ることが出来なかったからだ。

リンクはグーグルが計測するページ間のソーシャルなつながりである。ソーシャルなつながりを公開するべきなら、グーグルも偽善者面をするのではなく、リンクのつながりを公開するべきである。

最後にこのタイプのリンク分析を求めるグーグルやビングのユーザーの人数が僅かだとしても、それは関係がないと言っておこう。この問題が提起されると、この手のリクエストをする人がとても少ない点を理由に反論するケースが目立つ。

食べ物の材料のラベルを見る人は稀である。しかし、少数の気にする人達、または、突然詳しく知りたくなる人達のため、このラベルを提供するべきである。そのため、グーグルとビングもまたあらゆるサイトに関するリンクのデータを提供するべきなのだ。

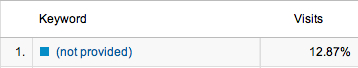

私はリンクデータの提供の停止を問題視しているが、昨年の10月にログイン中の検索エンジンのユーザー達がウェブサイトを見つけるために用いたキーワードをパブリッシャーにレポートする取り組みを止めた件に対してはさらに強い懸念を抱いている。

私はリンクデータの提供の停止を問題視しているが、昨年の10月にログイン中の検索エンジンのユーザー達がウェブサイトを見つけるために用いたキーワードをパブリッシャーにレポートする取り組みを止めた件に対してはさらに強い懸念を抱いている。

リンクのデータは、グーグルによって長い間抑えられてきた。キーワードのデータの非公開はまた別の問題である。

グーグルはユーザーのプライバシーを守るための取り組みだと説明している。グーグルの大半の従業員はこの点を信じているのだろう。しかし、プライバシーを本気で保護したいなら、このデータを有料の広告主には引き続き提供すると言う大きな抜け穴を意図的に開けておくべきではないはずだ。

また、グーグルが検索用語のプライバシーについて真剣に考えているのなら、クロームブラウザ内でのリファラーの引き渡しを無効にするべきではないだろうか。今のところは無効にはされていない。

先程の長々としたリンクデータの説明とは異なり、グーグルがリファラーのデータの提供を差し控える件に関してはざっと説明するだけで済ますつもりだ。なぜなら昨年10月の件に関して既に3000ワード以上の長文を綴っており、まだ続きがあるからだ。そのため、詳細は以前投稿した「グーグル、プライバシーに値段をつける」に目を通してもらいたい。

私が10月にこの件を取り上げて以来、キーワードのデータを広告主以外の人達には公開しない方針に対してグーグルがでっち上げた言い訳の中で最も理に適っていると思われる言い訳は、複雑で、取ってつけたような主張であり、さらにグーグルの立場を悪くするだけである。

グーグルは、広告主は無数の異なるキーワードに対して広告を購入する可能性があるため、リファラーのデータをブロックしても、アドワーズのキャンペーンの記録を見れば検索されている用語を把握することが出来ると主張している。

例えば、「Travenor Johannisoon income tax evasion settlement」(タラベノー・ヨハニソン 所得税 脱税 裁定)と誰かが検索を行ったとしよう。ちなみにこれは私が作った用語である。このエントリを作成している時点で、グーグルの検索「Travenor Johannisoon income tax evasion settlement」にマッチするウェブページは一つも見つからなかった。しかし…

検索用語はこのページを持つウェブサイトに伝えられるだろう。

その結果、「Travenor Johannisoon」に関連する「settlement for income tax evasion」が存在する可能性がある点をウェブ分析をチェックしているパブリッシャーに明かされることになると言える。つまり、パブリッシャーが探し始めれば、このタイプの情報を見つけられるかもしれないのだ。

当然だが、このような「settlement」が存在しない可能性もある。単なる噂なのかもしれない。しかし、事実ではなくても検索することは可能である。

通常、サイトが受けるウェブ分析の全てのデータに検索用語が埋もり、この特定の検索が気づかれる可能性は低く、まして、調査が行われることもないだろう。

しかし、念には念を入れ、グーグルはユーザーがサインインしている際にはキーワードのデータを渡す取り組みを停止した – 広告主以外には。先程も申し上げたように、情報の提供をブロックしたとしても広告主はこの情報を得る可能性があるとグーグルは主張している。

例えば、誰かが「income tax evasion」の検索とマッチする広告を運営しているとする。誰かが「Travenor Johannisoon income tax evasion settlement」の検索を行い、「Travenor Johannisoon income tax evasion settlement」の広告をクリックしたとすると、リファラーは広告主のウェブ分析システムにもたらされなくても、これらの用語はアドワーズのシステムを介して広告主に渡される。

それなら、わざわざブロックする必要はあるのだろうか?

確かに可能性がないわけではない。しかし、さらにプライベート化することが目的ならば、広告主および非広告主の双方に対して、リファラーデータをブロックをした方が効果は高いはずだ。グーグルはそれでも「Travenor Johannisoon」がアドワーズによってプライバシーを失う可能性がある“穴”を他にも残している。

例えば、「Travenor」および「tax evasion」のトピックで誰かが十分に検索を行った場合、グーグルインスタントの提案検索を作動させる可能性がある。

それなら、わざわざブロックする必要はあるのだろうか?

また、グーグルはログインしたユーザーのリファラーデータをブロックする一方で、同じ検索において、グーグルのウェブマスターセントラルを介してパブリッシャーに報告するキーワードのデータをブロックしていない。つまり、「Travenor」の検索用語はこのレポートで表示される可能性があるのだ。

それなら、わざわざブロックする必要はあるのだろうか?

グーグルが良かれと思った上での行動だっとしても、広告主以外の人達のみにリファラーをブロックする方針は偽善的だと言う私の考えに変わりはない。グーグルは、プライバシーを守るためだと主張しているが、自分のニーズおよび広告主の希望をプライバシーよりも重要視している点は明らかである。

リファラーのブロックは検索結果の暗号化とは別の問題である。暗号化は素晴らしい取り組みであり、今後も継続してもらいたい。しかし、グーグルは意図的にこの暗号化の仕組みを壊し、リファラーのデータを広告主に提供している。本来ならば、全てのユーザーに対してブロックするか、もしくはブロックを止めるべきなのだ。

どうやら、ここまで無事に読み進めてもらえたようなので、今までのおさらい、そして、前に進むための取り組みを挙げていこう。

ビングは新たにビングサイトエクスプローラを作らないのならば、リンクコマンドを復活させるべきである。グーグルにはリンクコマンドが全てのリンクを報告していることを確認し、グーグル自身のサイトエクスプローラの検討を行ってもらいたい。この双方においては、あらゆるサイトのアンカーテキストのレポートは絶対に欠かせない。

盗用もしくはサーバーの負担に関する懸念を持っているなら、ログイン時のみにこれらのツールを使えるようにすればよい。しかし、ヤフー!はこのツールを実際に提供していた。ブレッコも同じようなスタッツを提供している。小さな第三者の企業でも実施している取り組みである。メジャーな検索エンジンなら十分に処理することが出来るはずだ。

リファラーのデータに関しては、グーグルはすぐにグーグルのウェブマスターセントラルが報告するデータの量を増やす必要がある。現在、最高で1万の用語が過去30日間に対して表示される(グーグルは1000までと記載しているが、何かの間違いだと私達は考えている)。

11月、グーグルのスパム対策チームを統括し、暗号化プロセスにも関与するマット・カッツ氏は、パブコンでグーグルは期間を60日間に延期するか、クエリの数を2000に増加させることを検討していると話していた(先程も申し上げた通り、既に2000以上のクエリを確認することが出来る)。ちなみにキーワードの数を増やすよりも、期間を長くする選択肢を望む人達の方が若干多かった。

個人的には60日でも足りないと思う。リファラーのデータをブロックすると言うなら、継続的にレポートを行い、サイトの代わりに過去のデータを維持するべきである。グーグルは既にパブリッシャー達が維持してきた過去の基準を破壊しつつある。パブリッシャー達のデータを既に失っている。なぜならパブリッシャー達は毎日ウェブマスターセントラルを利用し、最新の情報をダウンロードしているわけではないのだ。

これまでのところ、グーグルはダウンロードを用意にするパイソンのスクリプトを提供しただけである。これでは不十分だ。グーグルはサイトが受け取る多数の用語を網羅する過去のデータも提供するべきである。それが正しい行動であり、既に提供しておいてもらいたかった。

GoDaddy(ゴーダディ)が狙った反SOPAのような取り組みは検索エンジンとは相容れないだろう。なぜなら、グーグルとビングから“引き出せる”最大のアイテムは広告とウェブサイトだからだ。しかし、これらのアイテムをパブリッシャーが大量のトラフィックを失うことなく移せる場所が存在しない。

GoDaddy(ゴーダディ)が狙った反SOPAのような取り組みは検索エンジンとは相容れないだろう。なぜなら、グーグルとビングから“引き出せる”最大のアイテムは広告とウェブサイトだからだ。しかし、これらのアイテムをパブリッシャーが大量のトラフィックを失うことなく移せる場所が存在しない。

ただし、打つ手がないわけではない。

ビングは、“悪”のグーグルに対して、“善”の検索エンジンとしてのイメージを作り上げるために必死である。そのため、パブリッシャー達は、ヤフー!サイトエクスプローラのビング版を維持しない方針は“悪”であり、リンクコマンドの閉鎖などもってのほかである点をビングにアピールしていくべきである。

ブログの投稿やツイートやカンファレンスで取り上げよう。このまま閉鎖させてはならない。ブレッコでさえ出来ることをなぜビングが出来ないのか、ビングに尋ねてみよう。

グーグルに対しては、関連性において、リンクデータの件でプレッシャーをかけるのが最善の策のように思える。グーグルはなぜ意図的にこのタイプの情報を調べることが出来ないようにしているのだろうか?そうすることで、スパムの問題が発生するよりも、関連性における弱点が晒されると心配しているのだろうか?話題を関連性に変えれば、グーグル – そして、パブリッシャー以外の人達の注目を得られるだろう。

また、開示性の問題も見過ごしてはならない。グーグルは、“何もかもさらけ出す”べきだと説きつつ、自分の都合の良いときだけ、まともな理由を説明することもせずに貝に閉じこもるべきではない。リンクのデータを引っ込める件に関しては、「閉鎖」の主張は筋が通らない。

リファラーのデータに関しては、グーグルには次の3つのルートで挑むべきである。

まず、グーグルの事業展開における反独占禁止に対する調査の一環として、FTC(連邦取引委員会)がパブリッシャーに声をかける可能性があるので、声をかけられたなら、リファラーのデータをグーグルの広告主以外には明かさない行為は、パブリッシャーが好んで利用するかもしれない競合するリターゲティングのサービスに悪い影響が出る可能性があると伝えておこう。反独占禁止の疑いは、グーグルが本気で懸念を抱えている点であるため、十分に利用しておきたいところだ。

次に、グーグルが守ろうとしている検索ユーザーに対してプライバシーの穴を意図的に開けたままにしておく理由を問いかけよう。本当に検索用語の露呈を心配しているなら、露呈する可能性のあるクエリを – 検索の提案、ウェブマスターセントラルでのレポート、アドワーズのレポート、そして、リファラーのデータを含むすべての手段から除く体系的な方法を用意するべきである。

最後に、グーグル自身のデータを抑制する問題に対してだが、2008年にグーグルアナリティクスに導入されたデータ共有を選択しているだろうか?その場合は、見合わせることを検討しよう:

無効にする場合は、ログインし、アカウントを選択し、次にOverviewウィンドウ内のアカウント名の隣の「Edit Analytics Account」を選ぶ。すると、上に表示したように、そして、このヘルプページでも説明されているように、選択肢が表示される。

選択を外すと、ベンチマーキングの機能(なかなか優れており、また、利用しなくても失われることはない)、そして、コンバージョンオプティマイザーを利用することが出来なくなる。コンバージョンオプティマイザーの利用を続けたいなら、この機能のオプトアウトを回避するべきであり、代わりに、その他の製品とではなく、この製品で利用するためだけにデータを共有する選択肢を設けるべきだとグーグルに要請しよう。

共有をやめるデメリットは他にもあるかもしれない。しかし、年始早々サーチエンジンランドでは共有をストップしているが、特に問題は起きていない。

グーグルはデータマニアである。パブリッシャーがデータを明かさない行為は、グーグルのデータを公開しない方針への不満を表す手段の一つである。そして、このような傾向にグーグルは敏感に反応する可能性がある。

この記事は、Search Engine Landに掲載された「2011: The Year Google & Bing Took Away From SEOs & Publishers」を翻訳した内容です。

その意味ではBingがこの辺りの機能を再拡充してウェブマスターを見方につけていくという手法は記事にもあるようにあるのかもしれませんが。もちろんSEO業者のいいように利用されるだけでは悲しいのですが。。。さて2012年の検索エンジン業界、どのような進展があるのでしょうか? — SEO Japan

SEO最新情報やセミナー開催のお知らせなど、お役立ち情報を無料でお届けします。